Smarthøytalere og mobiltelefoner som snakker til oss blir stadig vanligere, men hvordan de egentlig snakker til oss er ukjent for de fleste. Vi har laget en enkel introduksjon til teknologien bak.

Teknologikjempene Amazon, Apple, og Google prøver å ta over hjemmet ditt med sine digitale assistenter. På sikt er det ikke umulig at en smarthøytaler styrer lysene dine, temperaturen i stua, og låsen på døren.

Faktisk er det ikke vanskelig å gjøre det i dag.

Konkurransen om å bli hjernen i hjemmet ditt er bare så vidt i gang, og skal vi tro fremtidsprognosene vil salget av smarthøytalere nesten doble seg i 2018:

2018 Will Be Defining Year For Smart Speaker Adoption Growing To 56.3 Million Shipments By Year End https://t.co/zg20Ra463Q Smart speakers top AR, VR & wearables to become fastest-growing consumer tech via @TechCrunch & @sarahintampa https://t.co/eLnb8A4j4V #CES2018 #smart #audio pic.twitter.com/1SLOh4M6Fs

— Jim Harris (@JimHarris) 5. januar 2018

Allerede i dag eier hver sjette amerikaner en slik dings, og det er antagelig ikke lenge til de lanseres for fullt i Norge.

Det er også bekreftet at Google Assistant nå skal få norsk stemme, noe som antyder at en norsk lansering for Googles smarthøytalere ikke er langt unna.

Smarthøytalerne bruker talegjenkjenning til å registrere talekommandoene dine, som for eksempel: «Okay Google, play something on Spotify».

Denne kommandoen sendes til «skyen», hvor den tolkes, før smarthøytaleren svarer med talesyntese: «Sure, here’s some music on Spotify».

Det kan være lett å tro at dette er gjort i en fei, men det å legge til rette for tusenvis av spørsmål og svar er krevende av flere grunner.

La oss derfor se nærmere på akkurat hvordan tekst omgjøres til tale.

Slik fungerer talesyntese (i grove trekk)

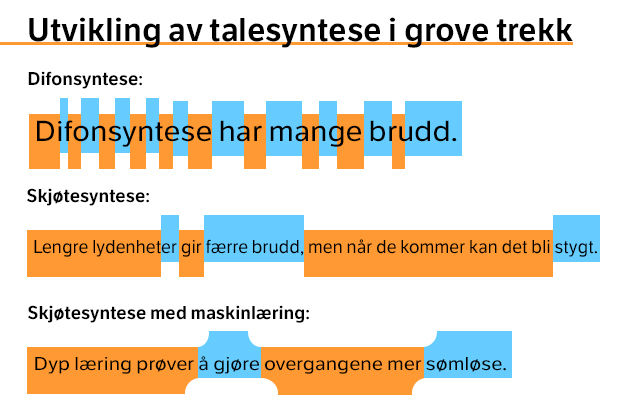

Talesyntese har forandret seg mye de siste årene, og det kan være greit å starte med en figur for å vise svært grovt en overgang fra oppstykket datastemme til de mer «naturlige» vi hører i dag:

For difonsyntese går man utfra de minste meningsbærende lydene i det språket, kalt fonemer. Dette er en eldre teknikk, og mange vil nok tenke på Microsoft Sam når de hører lydklipp laget på denne måten.

I figuren over ser dere hvordan to og to fonemer er ett helhetlig lydklipp. Et menneske har lest inn alle fonem-par som så settes sammen i alle mulige nye varianter.

Siden det bare er litt under 50 fonemer i norsk trenger man lite stemmedata for å lage talesyntese med denne metoden.

Problemet er at man får mange «brudd». Teknikken treffer på lydene isolert sett, men ikke helheten.

Kyle Kastner går igjennom hvordan han laget en enkel difonsyntese i programmeringsspråket Python. Nå er ikke dette klippet det beste teknikken har å tilby, men det gir et innblikk i hvordan lydene lappes sammen:

Trykket du på lydsporet hører du tydelig at stemmen «bryter» for nesten hvert bokstav og at stemmen har en robotisk klang.

Skjøter sammen menneskestemmer

Mer stemmedata åpner for å utvikle det som kalles skjøtesyntese. En stemmeskuespiller har kanskje spilt inn 30 timer med setninger som så blir satt sammen til nye kombinasjoner.

Denne metoden krever langt mer stemmedata, men fordi det er lengre mellom hvert skjøte høres det finere ut enn difonsyntese.

– Klassisk skjøtesyntese er veldig lite fleksibelt: Du har bare én stemme med ett tonefall som bare kan uttale de ordene du har opptak av. Dette gjør at egennavn blir problematiske, og de må ofte legges inn med for eksempel difonsyntese, sier førsteamanuensis Arild Brandrud Næss ved NTNU.

HMM: Stemmer laget fra modeller

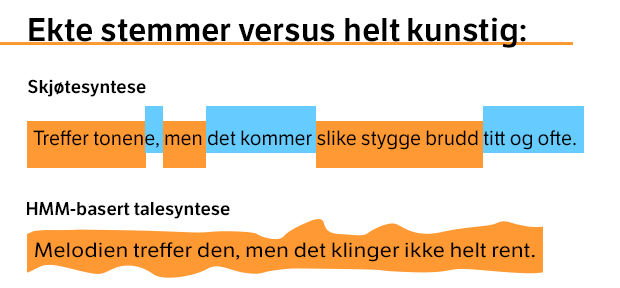

Lenge var talesyntese basert på en statistisk metode kalt skjulte Markov-modeller (HMM) hovedalternativet til skjøtesyntese.

– I motsetning til skjøtesyntese, genereres stemmen så å si fra scratch, sier Brandrud Næss, og legger til at det «i prinsippet gir fleksibilitet til å endre tonefall, setningsmelodi, emosjonalitet og mye annet.»

Denne tilnærmingen gir en mer robotisk klang enn skjøtesyntese, men har ikke de brå bruddene mellom hvert lydspor.

Fordi man her lager en kunstig stemme utfra en statistisk modell basert på menneskelige stemmer, istedenfor å klippe og lime små biter av én menneskelig stemme, er denne tilnærmingen også mer fleksibel.

Figuren under gir en visuell sammenlikning av de to metodene:

Grovt oppsummert kan man tenke seg at skjøtesyntese treffer de riktige tonene i språket fordi det er en person som har lest det inn, men metoden bommer på språkets melodi.

For tilnærminger basert på skjulte Markov-modeller er det motsatt: Fordi man har laget en modell av språket som er mer fleksibel vil den i større grad etterlikne melodien, men bomme på enkelttonene.

Derfor har man eksperimentert med å kombinere det beste fra hver hovedmetode.

De nyeste teknikkene kombinerer

Amazon, Google, Apple, og Microsoft jobber alle med å utvikle digitale assistenter som låner litt av de ulike hovedmetodene, og det er forskjeller i måten de går fram.

Ønsker du å lære mer om akkurat hvordan Apples Siri og Googles Wavenet fungerer har de publisert både akademiske artikler, og «enklere» innføringer.

Grovt sett er resultatet at stemmen ikke har de tydelige bruddene og høres mer menneskelig ut enn tidligere HMM-baserte metoder.

Oppstarten Voysis delte med Forbes et 42 sekunder langt lydklipp baserte på Googles Wavenet som langt på vei høres ut som en britisk kvinne:

Brukes allerede på en rekke området

I dag er talesyntese kanskje mest kjent for å brukes i:

- Digitale assistenter som Siri, Alexa, Google Assistant, og Cortana.

- Opplesning av bøker og nyhetsinnhold.

- Verktøy for svaksynte og blinde.

I tillegg er det en drøm om å utvikle et verktøy som kan simultanoversette mellom to personer som ikke snakker det samme språket.

Kanskje det beste eksempelet er babelfisken fra science fiction-universet Hitchhiker’s Guide to the Galaxy.

Der holdt å det putte den i øret, og plutselig kan du alle språk.

Google har med sine Pixel Buds kommet et stykke på vei, og kan ifølge dem selv simultanoversette mellom 40 språk.

Du kan selv gjøre det opp en mening om hvordan det fungerer mellom svensk og engelsk her:

Om noen begynner å mumle «Skynet» eller «robotene overtar» kan dette sitatet roe nervene:

– Menneskelig tale er fortsatt gullstandarden og vil være å foretrekke i lang tid framover, sier Arild Brandrud Næss.

For selv om det har vært en rekke fremskritt på feltet oppfattes ennå kunstige stemmer som ja, kunstige.

Dette er ikke den første gangen NRKbeta skriver om digitale assistenter og utviklingen på stemmefronten. Sjekk ut våre tidligere saker:

VI BØR GÅ OVER TIL Å KALLE DET SMARTMIKROFON, OG IKKE SMARTHØYTALER.

Det som nå kalles «smarthøyttaler» burde jo i stedet kalles «smartmikrofon» (eller «smartlytter»?). Det var selvfølgelig vel planlagt at produsentene kalte det nye produktet sitt «smarthøyttaler», for at det derved skulle det høres mindre skummelt ut. En høytaler høres jo svært så ufarlig ut siden den bare leverer informasjon fra maskinen til de i rommet.

Men den interessante og skumle teknologien i dette apparatet ligger jo i mikrofonen, og at den naturlige bruken er at den står på og lytter til alt som blir sagt i rommet hele tiden. Det er jo til og med slik å slå den av på greiest gjøres med en stemmekommando heller enn ved å koble den fysisk fra. Dette kontrolleres altså av maskinen, og om noen skulle førsøke å lage systemer som sikrer deg at ingen uvedkommende kan høre hva som sies, så kan jo dette, som alll annen programmert elektronikk, hackes av de som måtte ha litt ressurser, siden de jo naturlig er knyttet til nettet.

Sørgelig få av de som omtaler dette produktet (også uavhengige omtaler som jeg lest) trekker, med særlig kraft, fram disse sørgelige sidene ved denne teknologien. Et første skritt kunne være å gå over til å kalle det «smartmikrofon», eller sågar «smartlytter», i stedet for det misvisende og nøytraliserende navnet «smarthøyttaler».

[…] du er nysgjerrig på utviklingen av talesyntese har NRKbeta skrevet en mer dyptgående artikkel […]