Dette er en kommentar. Den bygger på skribentens egne analyser, meninger og vurderinger.

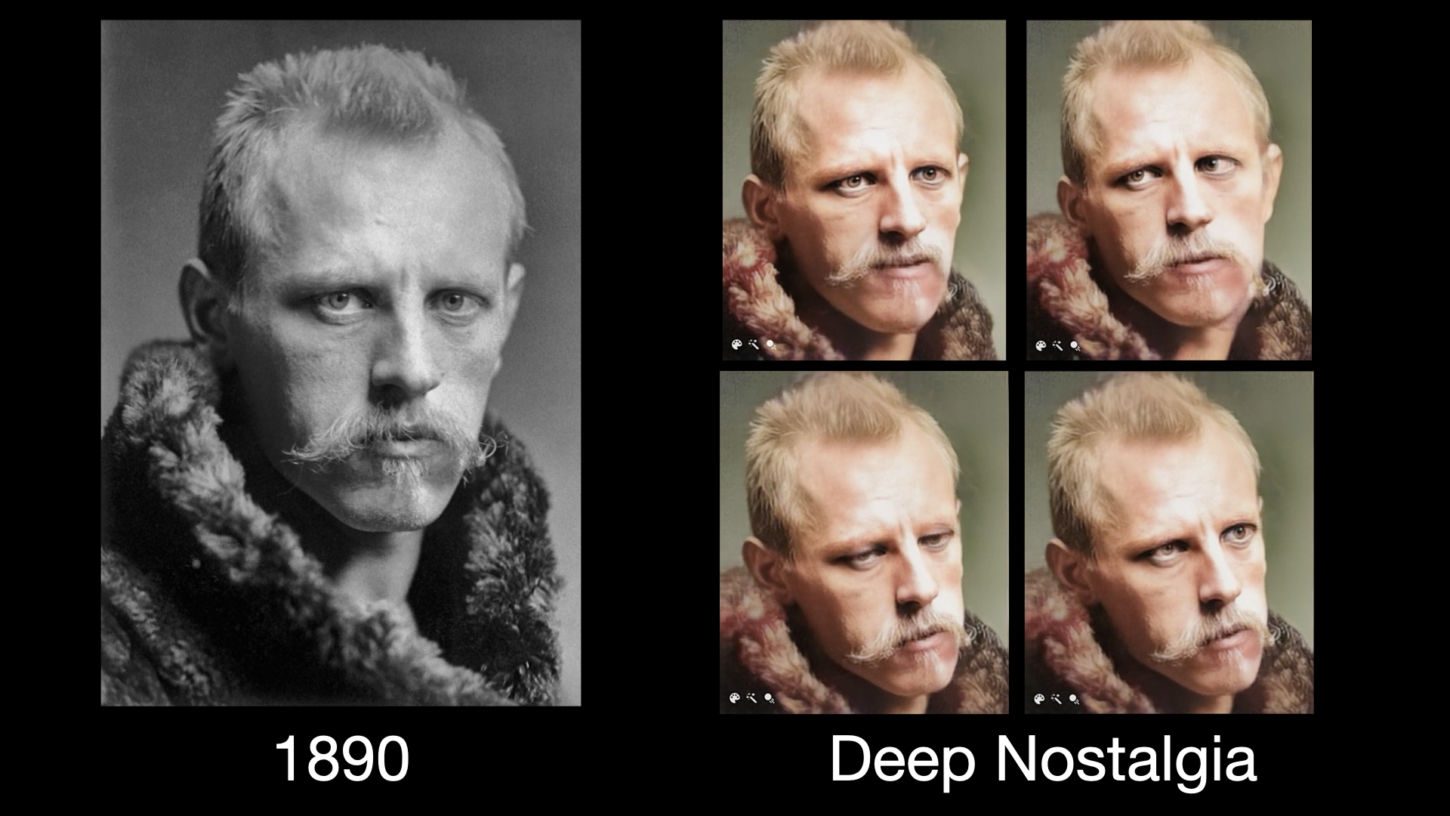

Fridtjof Nansen snur på hodet, blunker, og setter opp et forsiktig smil. Han blir overraskende livaktig, men også ganske skremmende når den kunstige intelligensen prøver å vekke ham til live.

Utgangspunktet mitt er et kjent stillbilde av den tøffe polfareren. Det har nå blitt til en liten video der Nansen er en urovekkende skikkelse som minner meg om en blanding av Rutger Hauer som iskald robot i Bladerunner og et eller annet enda skumlere.

Etter testen får jeg mest lyst til å oppsøke Nansens grav for å be om unnskyldning. Jeg tenker at jeg burde fått tillatelse fra personen i portrettet før jeg gjorde såpass levendegjørende og grundig maipulering av bildet.

Det er «Deep Nostalgia», en tjeneste levert av slektsforskningsnettstedet MyHeritage, som har skapt denne forstyrrende versjonen av Fridtjof Nansen.

Den fiffige tjenesten har tatt internett med storm de siste ukene. Der har brukere delt utallige videoer der de har fått liv i alt fra gamle statuer til malerier.

Et smil fra mormor

Tanken bak tjenesten er nok at du skal kunne få liv i bilder av gamle slektninger. Kanskje til og med lure et lite blunk eller et smil ut av en bestemor du savner.

Skuespillerinnen Agnes Mowinckel er en slektning av meg og var helt sikkert vant til å bli fotografert. Jeg bestemte meg for at hun sikkert ville tilgitt meg å teste denne invaderende fiklingen på et bilde av henne.

Det tok bare noen tastetrykk å omgjøre det gamle og grovkornede bildet til et forbedret og animert videoklipp. Dette fungerte bedre. Den litt undrende kvinnen som plutselig beveget seg og tittet rundt i billedrammen sin fascinerte meg.

Kombinasjonen av støyfjerning og levendegjøring vekket noe i bildet som jeg ikke så med en gang. Jeg begynte plutselig å kjenne igjen trekk fra andre slektninger.

Falske politikere og pornofilmer

Såkalte «deepfakes» skapte mye oppstyr da de dukket opp for noen år siden. Den teknologien gjør det mulig å lage forbausende troverdige videoer der dialog eller ansikt er byttet ut. Den kan brukes til å få mennesker til å snakke språk de ikke kan, få politikere til å si ting de aldri har sagt eller få kjente skuespillere til å dukke opp i pornoscener de aldri har vært med i.

Deep Nostaliga baserer seg på en lignende teknologi. Avansert maskinlæring fra det israelske selskapet D-ID har analysert bilder og videoer for å så kunne konstruere animasjon ut av det som bare er stillsfoto.

Resultatet er imponerende, men ikke perfekt. Og det er problemet her.

Det finnes et eget begrep for det som kan skje når vi prøver å lage realistiske animasjoner av mennesker. Eller prøver å lage roboter som skal se ut som mennesker.

Når de blir veldig bra, men ikke helt perfekte havner vi i det som kalles «den uhyggelige dal», eller «the uncanny valley» på engelsk. Konseptet ble formulert av robotikkprofessoren Masahiro Mori i 1970. Til og med apekatter reagerer med frykt når de får se bilder av realistiske, men datagenererte bilder av andre aper.

Vil du vite mer om billedbehandling og kunstig intelligens?

Meld deg på det fyldige nyhetsbrevet vårt. Vi kommer aldri til å misbruke adressen din.

Første skudd er gratis

For å bruke Deep Nostalgia må du registrere deg for en gratis prøveperiode som varer i 14 dager før MyHeritage begynner å slurpe penger ut av kredittkortet ditt. Her må du også takke ja til vilkår som er såpass drøye at Datatilsynet har åpnet sak mot dem etter en klage fra Forbrukerrådet.

Heldigvis finnes det andre alternativer som gratisappen Muglife. Den er tilgjengelig på iOS og Android. Er du mer interessert kan du også leke deg med First Order Motion, et prosjekt som er basert på åpen kildekode.

Tenk deg om

Det å dra slektninger, malerier og statuer ned i den uhyggelige dal har blitt en viral hit som garantert driver flere inn til slektsgranskningstjenestene til selskapet.

Du bør likevel tenke deg om to ganger før du lar denne underholdende funksjonen lokker deg inn i en enda mer uhyggelig dal: Å sende DNA-et ditt til et utenlandsk selskap. Det angrer ihvertfall jeg selv på.

Hvis det overrasker noen at teknologien skulle klare dette, burde stoppe opp å tenke litt. Tjenester som FaceTime og lignende kommer til å bli utnyttet av kriminelle, eller til egen vinning i fremtiden, med blant annet fiktive samtaler mellom fortroende osv. Det gjelder for oss å følge med og vite hva vi bruker teknologien til. Og hvordan vi»vanlige» bruker den.

Tror det ikke før jeg ser det.

Eller?

Jeg ser Woody Harrelson på sitt mest utkrøpne mer enn Rutger Hauer. Uansett grei karikatur av Nansen for presentasjon på 8. mars.

Tre rette!? Fantastisk. Hva skal jeg nå skrive etter at jeg vant quizen?

Ikke helt det samme, men også en fasinerende bruk av maskinlæring. Her er det en kar som har tatt gamle analog filmer fra århundreskiftet, upsamplet både oppløsning og framerate samt fargelagt og lagt på litt lydeffekter.

Resultatet er bemerkelsesverdig vei gjennomført.

Her er link til videoen på YouTube

youtu.be/YZuP41ALx_Q

(Denis Shirayev som står bak videoen har mange andre videoer også, alt fra Rover-kjøring på månen til Japan på tidlig 1900 tall)

Hvordan fungerer disse tjenestene for ikke-hvite? Dårligere eller samme? Om man tenker på ansiktsgjenkjenning, er disse bedre på hvite enn ikke-hvite – eller er det ingen paralleller?

Det kommer an på hvilket grunnlag de har brukt for å trene algoritmene. Slike algoritmer blir best på det de er trent til. Så om de trenes mest på mennesker med en type utseende så blir de flinkest til å manipulere bilder der menneskene har den samme typen utseende.

Etter hva jeg har sett på andre fora (reddit osv) ser det ut til å funke helt fint på alle personer.

Hvor tydelige kontrastene er i bildet man mater inn, har mye mer å si enn etniske trekk og hudfargetoner. Bildet «tydes» jo maskinelt, da vil det alltid være forholdsvis harde terskelverdier for hva oppfattes som en del av ansiktstrekk, hva oppfattes som bakgrunn, eller filtreres ut som støy. Selv en hypermoderne, kraftig AI har ingen evne til *subjektiv* tenkning eller vurderinger, slik vi mennesker har. En AI kan kun gjøre *objektive* vurderinger, men til gjengjeld kan den i mange tilfeller gjøre små, relativt enkle objektive vurderinger, med mye høyere presisjon enn vi kan.

Vi mennesker kan se på et temmelig utydelig bilde, tyde mange detaljer som er nesten helt utvasket, til og med mentalt fylle inn detaljer som er totalt utvasket eller helt borte fra bildet. Vi kan justere våre egne «terskelverdier» uendelig (innenfor hva øyet kan se selfølgelig), og ulikt for hver eneste bilde vi ser på, utfra uendelig mange kontekst-faktorer.

Mht maskinell lesning, et fargefoto har nok mye mer «å gå på», uavhengig av hudtone. Sorthvitt-bilder (og enkelte fargebilder konvertert til gråskala) vil naturligvis ha mindre å jobbe med. Et portrett av noen lyshudet som har blitt litt overeksponert, vil trolig programvaren ha like mye vansker med som f.eks. portrett av noen mørkhudet med for lav eksponering. Da mye av kontrasten i ansiktstrekk-linjene kan bli såpass utvasket at dem bekker over (eller under) grenseverdiene for hva programvaren «får med seg». Det er altså ikke hvilken «farge» som spiller noen rolle, men kontrastene imellom dem.

Dette er forsåvidt ikke noe nytt konsept eller ny utfordring, med maskinell tolkning. Slik var det fra tidlig av med kopimaskiner, tidlige scannere og spesielt fax-maskiner. Problemstillingen er der på nye moderne maskiner også, men ikke like ille som før. Det øyeblikket man ber om noe mer enn 1:1 identisk kopi, må maskinen begynne tolke hva er hva, hva er objektet etc. Da går det raskt i nedoverbakke med fine, granulære detaljer – noen vage detaljer forsvinner, og andre kan bli kraftig forsterket.

OT: Når begynte forstyrrende å bety urovekkende/skremmende på norsk? Det er så annoying når folk i news media mixer norsk og Engelsk.

Jeg kan ikke se at dette er mer «uhyggelig» enn å spole fram gamle live action-filmer med ens avdøde bestemor.

Disturbing på engelsk BETYR nettopp foruroligende eller skummelt. Hvis du trodde det betydde «forstyrrende» tar du feil. Disrupting betyr forstyrrende.

@Timmeh

«Do not disturb»

«Ikke forurolige meg»

«Ikke skummel meg»

@Niza

Nå må du ikke blande engelsk dagligtale og korrekt engelsk. De fleste som bruker engelsk til daglig har bare plukket opp deler av språket, og har aldri fått nevneverdig opplæring.

Terrific thought, isn’t it?

Interessant. Men ja, det koster.

Interessant og viktig artikkel! MyHeritage begynte for ca et år siden å gi brukerne mulighet til å «rense» gamle fotografier, og litt etter å fargelegge dem. Nå kan vi altså manipulere et fotografi slik at personen på bildet tilsynelatende også beveger øynene og hodet. Dette er selvfølgelig interessant, men som Erik skriver i artikkelen, også skummelt: «Jeg tenker at jeg burde fått tillatelse fra personen i portrettet før jeg gjorde såpass levendegjørende og grundig maipulering av bildet.»

Det tok ikke mange år etter at fotografiet ble oppfunnet (1825) før fristelsen til å manipulere bildene i mørkerommet (der fotoplatene ble overført til fotopapir) ble for stor. To godt kjente, historiske bilder er «Ulysses S. Grant at City Point» (1902) der den amerikanske generalen Ulysses S. Grant har fått hodet sitt plassert på en soldat som sitter på en hest. Hest og soldat er montert i forgrunnen av et annet foto av slagmarken. Det andre bildet er «Familienporträt Goebbels» (1944) der et av familemedlemmene ikke var tilstede men likevel ble manipulert inn i bildet. Vi vet jo også hvordan totalitære regimer (Stalin, Hitler, Mussolini, Mao) bevisst har retusjert fotografier ved å fjerne personer som «ikke lenger passet inn» i bildet.

I 2019 ble fotografen Beth Moon anklaget for å ha manipulert et bilde hun tok av stjernehimmelen ved å bruke Photoshop til å klone en gruppe av stjernene. Bildet var allerede lagt ut på National Geographics hjemmeside, og det vakte store reaksjoner. Burde ikke bildet ha blitt publisert? Burde det ha vært tydelig merket slik at vi ble klar over manipuleringen? Hvordan kan vi heretter stole på fotografiene til Beth Moon?

Nyeste versjon av Photoshop er blitt så intelligent at programmet kan forandre et trist eller alvorlig ansikt til et som ser tilsynelatende glad ut. Det er lett å tenke seg hvor begeistret Goebels nærmeste medarbeidere hadde blitt hvis de hadde hatt slike verktøy når de forsøkte å ta kontrollen over historiefortellingen under Andre Verdenskrig.

Uansett hvor spennende vi synes kunstig intelligens er, så mener mange at denne utviklingen har en etisk side som vi fort kan begynne å angre på at vi ikke tok alvorlig. Elon Musk (Tesla/SpaceX) sa i februar i år at «Advanced Artificial Intelligense is humanity’s biggest existential threat if left unchecked.» og i en Twitter-melding 18. februar: «All orgs developing advanced AI should be regulated, including Tesla.»

Vi kan mene hva vi vil, men det viktigste ansvaret vi har er å gjøre det våre etterkommere ønsker. Det er et etisk ansvar. Vil vi at våre barnebarns barn skal få et mest mulig virkelighetsnært bilde av vår felles historie, er det vi som må ta ansvar og finne måter å merke manipulerte bilder slik at de kan skilles fra de originale fotografiene. Ikke ulikt hvordan kildehenvisninger brukes av seriøse journalister og forfattere.

Interessant og viktig artikkel! MyHeritage begynte for ca et år siden å gi brukerne mulighet til å «rense» gamle fotografier, og litt etter å fargelegge dem. Nå kan vi altså manipulere et fotografi slik at personen på bildet tilsynelatende også beveger øynene og hodet. Dette er selvfølgelig interessant, men som Eirik skriver i artikkelen, også skummelt: «Jeg tenker at jeg burde fått tillatelse fra personen i portrettet før jeg gjorde såpass levendegjørende og grundig maipulering av bildet.»

Det tok ikke mange år etter at fotografiet ble oppfunnet (1825) før fristelsen til å manipulere bildene i mørkerommet (der fotoplatene ble overført til fotopapir) ble for stor. To godt kjente, historiske bilder er «Ulysses S. Grant at City Point» (1902) der den amerikanske generalen Ulysses S. Grant har fått hodet sitt plassert på en soldat som sitter på en hest. Hest og soldat er montert i forgrunnen av et annet foto av slagmarken. Det andre bildet er «Familienporträt Goebbels» (1944) der et av familemedlemmene ikke var tilstede men likevel ble manipulert inn i bildet. Vi vet jo også hvordan totalitære regimer (Stalin, Hitler, Mussolini, Mao) bevisst har retusjert fotografier ved å fjerne personer som «ikke lenger passet inn» i bildet.

I 2019 ble fotografen Beth Moon anklaget for å ha manipulert et bilde hun tok av stjernehimmelen ved å bruke Photoshop til å klone en gruppe av stjernene. Bildet var allerede lagt ut på National Geographics hjemmeside, og det vakte store reaksjoner. Burde ikke bildet ha blitt publisert? Burde det ha vært tydelig merket slik at vi ble klar over manipuleringen? Hvordan kan vi heretter stole på fotografiene til Beth Moon?

Nyeste versjon av Photoshop er blitt så intelligent at programmet kan forandre et trist eller alvorlig ansikt til et som ser tilsynelatende glad ut. Det er lett å tenke seg hvor begeistret Goebels nærmeste medarbeidere hadde blitt hvis de hadde hatt slike verktøy når de forsøkte å ta kontrollen over historiefortellingen under Andre Verdenskrig.

Uansett hvor spennende vi synes kunstig intelligens er, så mener mange at denne utviklingen har en etisk side som vi fort kan begynne å angre på at vi ikke tok alvorlig. Elon Musk (Tesla/SpaceX) sa i februar i år at «Advanced Artificial Intelligense is humanity’s biggest existential threat if left unchecked.» og i en Twitter-melding 18. februar: «All orgs developing advanced AI should be regulated, including Tesla.»

Vi kan mene hva vi vil, men det viktigste ansvaret vi har er å gjøre det våre etterkommere ønsker. Det er et etisk ansvar. Vil vi at våre barnebarns barn skal få et mest mulig virkelighetsnært bilde av vår felles historie, er det vi som må ta ansvar og finne måter å merke manipulerte bilder slik at de kan skilles fra de originale fotografiene. Ikke ulikt hvordan kildehenvisninger brukes av seriøse journalister og forfattere.